Das iPhone 12 Pro ist Apples erstes Smartphone mit einem Light Detection and Ranging (LiDAR)-Scanner auf der Rückseite. Aber was macht LiDAR und wofür plant Apple, es in Zukunft einzusetzen?

Inhaltsverzeichnis

Was ist LiDAR?

Ein LiDAR-Scanner bestimmt den Abstand zwischen sich und einem Objekt, indem er überwacht, wie lange es dauert, bis ein Lichtimpuls (häufig ein Laser) zurückgeworfen wird. Es ist wie Radar, außer dass es anstelle von Radiowellen Infrarotlicht verwendet.

Während Radar für den Einsatz über große Entfernungen ausgelegt ist, arbeitet LiDAR aufgrund der Art und Weise, wie Licht von Objekten auf seinem Weg absorbiert wird, in einem kleineren Maßstab. Durch das Senden von Hunderttausenden von Lichtimpulsen pro Sekunde können LiDAR-Scanner Entfernungen und Objektgrößen mit relativer Genauigkeit über kleine Entfernungen ermitteln.

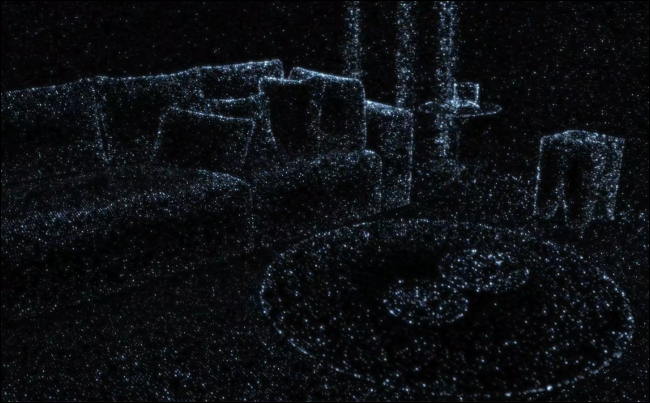

Diese Daten können dann zum Erstellen von 3D-Modellen verwendet werden, was eine der Hauptanwendungen für LiDAR in Bau- und Ingenieurprojekten ist. Sie haben wahrscheinlich schon davon gehört, dass 3D-Laserscans zur Erstellung von Gebäudeplänen verwendet werden – das ist LiDAR.

LiDAR hat tatsächlich viele Anwendungen in vielen Branchen. Archäologen verwenden es, um Ausgrabungsstätten vorzubereiten, und autonome Fahrzeuge verlassen sich darauf, um Echtzeit-3D-Karten ihrer Umgebung zu erstellen. LiDAR wurde sogar verwendet, um äußerst realistische und genaue Karten von Rennstrecken in Videospielen wie Project CARS zu erstellen. Speedguns der Polizei verwenden ebenfalls LiDAR.

Und jetzt ist, genau wie beim iPad Pro im März 2020, ein LiDAR-Scanner zu Apples Premium-iPhone 12 Pro gekommen.

So verwendet das iPhone 12 Pro LiDAR

Apple verwendet LiDAR etwas anders als eine Baustelle oder Blitzpistole. Es ist das gleiche Grundprinzip – reflektierendes Licht zur Bestimmung der Entfernung – aber in kleinerem Maßstab. Der LiDAR-Scanner im iPhone 12 Pro (und iPad Pro) hat eine effektive Reichweite von etwa 5 Metern.

Der Hauptzweck von LiDAR im iPhone besteht darin, die Implementierung von Augmented Reality (AR) zu verbessern. Es wird Apps nützlichere und genauere Informationen über ihre Umgebung geben, für eine reibungslosere und zuverlässigere AR.

Wenn Sie mit der Technologie nicht vertraut sind, ermöglicht AR Entwicklern, virtuelle Objekte und die reale Welt zu verschmelzen. Es verwendet die Kamera Ihres Geräts und ermöglicht es Ihnen, Spiele zu spielen, interaktive Filter (wie die auf Snapchat) anzuwenden oder eine Vorschau der Platzierung von Möbeln und anderen Objekten anzuzeigen.

Pokémon Go ist ein Beispiel für ein erfolgreiches AR-Spiel, mit dem Sie virtuelle Kreaturen in der realen Welt einfangen können. Mit der äußerst erfolgreichen Place-App von Ikea können Sie sehen, wie die meisten Kataloge des Unternehmens in Ihrem Zuhause aussehen würden.

LEGO ist eines von vielen Unternehmen, das auch eigenständige Produkte (in diesem Fall Bausets) auf den Markt gebracht hat, die über AR-Funktionen „lebendig“ werden können, wenn Sie ein kompatibles Smartphone haben.

Während LiDAR häufig zum Scannen von Gebäuden und anderen Objekten verwendet wird, ist der Scanner auf dem iPhone 12 Pro und iPad Pro nicht genau genug, um Objekte genau zu scannen. Sebastiaan de With, der die beliebte iPhone-Kamera-App entwickelt hat Halogenid, entdeckte dies beim Erstellen eines Proof of Concept namens Esper.

„Leider ist die Mesh-Ausgabe des Systems im Moment nicht genau genug, um sie an einen 3D-Drucker zu senden“, schrieb de With auf der Halide-Website. „Aber es ist ein großartiger Ausgangspunkt für ein 3D-Modell, da alle Proportionen sehr genau sind.“

In Wirklichkeit werden LiDAR-Scanner wahrscheinlich zwei Hauptaspekte verbessern: die Platzierung virtueller Objekte (wie Einkaufs-Apps) und AR-Spiele. Dies ist bereits auf Nicht-LiDAR-iPhones möglich, aber es fügt Dingen wie Abmessungen und der genauen Entfernung zu einem Objekt in einem Raum eine zusätzliche Genauigkeitsebene hinzu.

Sie können auch ein nahtloseres AR-Erlebnis erwarten, insbesondere wenn Sie virtuelle Gegenstände in der realen Welt platzieren. So soll das iPhone 12 Pro beispielsweise reale Gegenstände im Vordergrund besser erkennen können. Dies soll für realistischere Interaktionen zwischen virtuellen und realen Objekten sorgen.

Apple beabsichtigt auch, LiDAR zu verwenden, um die Kameraleistung bei schlechten Lichtverhältnissen zu verbessern. Es hat „Fokuspixel“ im iPhone XS implementiert, der Marke des Unternehmens für Phasenerkennungs-Autofokus (PDAF). Diese Technologie ist immer noch auf Licht angewiesen, weshalb selbst die neuesten Autofokus-Fortschritte im Dunkeln nicht so gut funktionieren.

Durch Erfassen der Entfernung zwischen Ihrem iPhone und dem Motiv, von dem Sie ein Bild aufnehmen, kann Apple der Kamera mitteilen, auf welche Entfernung sie fokussieren soll, um die besten Ergebnisse zu erzielen. Das soll es deutlich einfacher machen, mit dem iPhone im Dunkeln bessere Fotos zu machen, vor allem in Kombination mit dem Nachtmodus.

Wird LiDAR ein großer Deal?

Derzeit haben nur zwei Apple-Geräte einen Sensor. Beide sind ebenfalls preisgünstig und mit dem Spitznamen „Pro“ versehen, sodass LiDAR vorerst eine Nischenfunktion ist. Das bedeutet jedoch nicht, dass sich die Software nur langsam durchsetzen wird. Apples erschöpfende Liste von Software Development Kits (SDKs) enthält ARKit, das im Juni 2020 auf Version 4.0 aktualisiert wurde.

Dieses Update führte neue Funktionen ein, die LiDAR in ARKit nutzen, sodass Entwickler den neuen Sensor des iPad Pro und des iPhone 12 Pro nutzen können. SDKs wie dieses ermöglichen es Entwicklern, ganze Familien von Geräten anzusprechen, selbst wenn sie nicht den neuesten Schnickschnack rocken.

Apples Plan sieht wahrscheinlich vor, LiDAR-Sensoren im Laufe der Zeit in mehr Geräte einzubauen, während die Entwickler damit beschäftigt sind, Apps zu entwickeln, die die verbesserte Leistung nutzen. In Anbetracht des erneuten Interesses des Unternehmens an der Technologie in den letzten paar Softwareversionen scheint Apple groß auf AR zu setzen.

Apples größte Pläne für LiDAR könnten jedoch weit über Tablets und Smartphones hinausgehen. Das ist zumindest die Meinung vieler Analysten, da Gerüchte über das Unternehmen anschwellen Gerüchten zufolge AR-Brille. Wenn ein solches Projekt verwirklicht werden sollte, wäre es sinnvoll, dass eine genaue AR die Grundlage für die Erfahrung wäre.

Durch die Ermutigung von Entwicklern, AR zu nutzen, kann Apple die App-Verfügbarkeit auf einer neuen Wearable-Plattform beschleunigen. Ein langsamer Rollout bei einigen High-End-Modellen folgt dem Trend von Apple mit früheren iPhone-Funktionen, darunter haptisches Feedback, Gesichtserkennung und mehrere Kameras.

Die Integration von Hardware, die AR direkt zugute kommt, in ausgewählte Geräte gibt dem Unternehmen auch die Möglichkeit, sie zu optimieren, bevor ein Produkt auf den Markt gebracht wird, das sich stärker auf die Technologie stützt.

Ist LiDAR ein Upgrade wert?

Wenn es darum geht, sich zwischen dem iPhone 12 oder iPhone 12 Pro zu entscheiden, wird LiDAR Sie wahrscheinlich nicht beeinflussen. Wenn Sie nicht viele Apps verwenden, die AR nutzen, oder nachts viele Fotos schießen, werden Sie kurzfristig keine Vorteile sehen.

Selbst wenn Sie ein begeisterter AR-Gamer oder Flat-Pack-Süchtiger sind, hat sich die AR-Implementierung in aktuellen iPhones ohne LiDAR in nur wenigen Generationen dramatisch verbessert. LiDAR verbessert dies zwar noch weiter, aber es ist wahrscheinlich nicht die 300-Dollar-Prämie wert, die Apple für das iPhone 12 Pro verlangt.

Die meisten Menschen sind im Moment vielleicht nicht übermäßig begeistert von LiDAR, aber die Technologie wird sich in den kommenden Jahren durchsetzen und das gesamte iPhone-Erlebnis verbessern. Es ist auch nicht der einzige große Fortschritt in der iPhone-Reihe 2020 – es gibt ein neues Ökosystem aus MagSafe-Zubehör, 5G-Unterstützung und Dolby Vision-Aufnahme.